Comment ChatGPT comprend le langage ? - Partie 1

Le langage comme des chiffres

Chaque jour, des millions de personnes posent des questions à ChatGPT :

"Peux-tu m’aider à écrire un post LinkedIn ?"

"Quel est le meilleur moment pour publier sur Instagram ?"

"Raconte-moi une blague sur les freelances."

Et la machine répond. Avec du sens. Du style. De l’humour, parfois.

Mais au fond…

Comment une machine peut-elle comprendre une phrase humaine ?

Elle ne comprend pas comme nous

ChatGPT n’a pas de conscience.

Il ne devine pas ton intention en lisant entre les lignes comme le ferait un ami.

Il ne ressent rien. Il ne fait qu’une chose, extraordinairement bien :

👉 Il transforme ta phrase en chiffres, puis il fait des calculs très, très vite.

Ce n’est pas de la magie.

C’est des maths invisibles — cachées sous la surface de chaque interaction.

Les mots deviennent des nombres

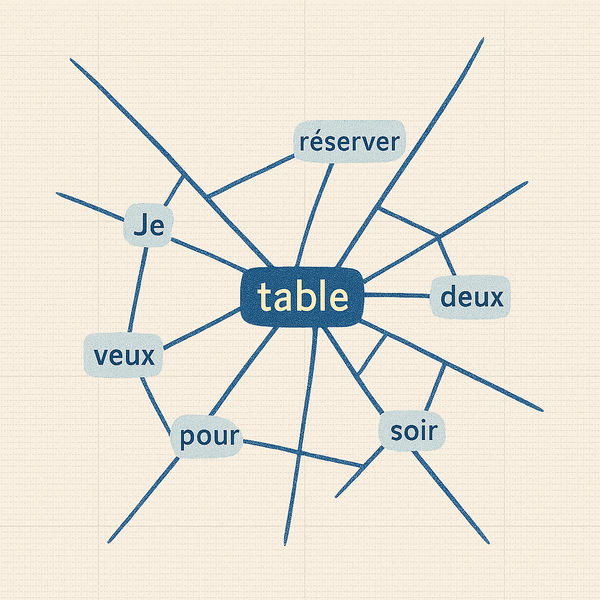

Avant de répondre, ChatGPT doit traduire ta phrase en une forme qu’il peut comprendre et manipuler.

Les ordinateurs ne comprennent pas les mots comme nous.

Pour eux, tout est données numériques : 0, 1, 0, 1...

Donc ta phrase :

"Quel est le meilleur moment pour publier sur Instagram ?"

… est convertie en une suite de nombres, grâce à un processus appelé encodage.

Mais attention : ce n’est pas une simple liste du style :

"quel" = 1732, "meilleur" = 8291, etc.

Non. Ce serait trop rigide, et surtout inutile.

Il faut que ces chiffres capturent un peu de sens, de contexte, de nuance.

Une métaphore pour mieux comprendre : la recette traduite

Imagine que tu veux que ton robot cuisinier prépare un gâteau.

Tu lui donnes une recette écrite :

"Mélange deux œufs, 100 g de sucre et 120 g de farine."

Sauf que ce robot ne comprend pas le français.

Tu dois d’abord traduire cette recette en instructions numériques précises :

des poids, des durées, des températures…

C’est exactement ce que fait ChatGPT avec ta phrase :

Il transforme le langage en ingrédients numériques qu’il pourra traiter.

Et ChatGPT n’est pas seul

Même si on parle souvent de ChatGPT, il n’est pas le seul modèle d’intelligence artificielle capable de comprendre et de générer du langage.

Il existe aussi :

- Claude (par Anthropic),

- Mistral (modèle open source français),

- DeepSeek (modèle chinois très performant),

- LLaMA (développé par Meta),

- et bien d’autres.

Tous fonctionnent plus ou moins selon les mêmes grands principes mathématiques, mais avec des architectures, des jeux de données et des objectifs différents.

👉 Comprendre comment ces modèles fonctionnent, c’est aussi mieux les utiliser… quel que soit leur nom.

Ce qu’il faut retenir

Avant même de penser à une réponse, ChatGPT (et les autres modèles) décomposent ta phrase en chiffres,

puis les préparent à passer dans une série de transformations complexes (qu’on verra dans la suite).

C’est cette traduction mathématique du langage qui rend possible toute la suite du processus.

👉 Dans la prochaine partie, on verra comment ces mots traduits en chiffres deviennent des vecteurs, c’est-à-dire des sortes de positions dans un espace du sens.

Une manière pour l’IA de comprendre que "chat", "chien" et "animal" sont liés, même si ce sont des mots différents.